Je hebt het vast gemerkt: de discussie over Artificial Intelligence (AI) wordt steeds luider en beangstigender. Wat gisteren nog sciencefiction leek, eist vandaag al regels. Terwijl wij in Nederland soms nog wachten op duidelijke richtlijnen, zetten landen als China, Indonesië en nu ook Zuid-Korea serieuze stappen om hun burgers te beschermen.

Dit is geen verre toekomstmuziek meer; de wetten worden nu gesmeed. Als je denkt dat dit je werk of je dagelijkse apps niet raakt, heb je het mis. De regels in Seoel zijn flink streng en kunnen een blauwdruk worden voor hoe wij hier in Europa hun innovatie kunnen remmen of juist sturen.

Wat Zuid-Korea nu verandert (en waarom jij dit moet weten)

Zuid-Korea heeft recentelijk hun eigen AI-wetgeving gelanceerd. Het doel? Vertrouwen en veiligheid garanderen in deze razendsnel ontwikkelende sector. Ze richten zich specifiek op 'hoog-impact' AI-systemen, en die lijst is verrassend lang.

De kritieke sectoren onder menselijk toezicht

De Koreaanse regering heeft besloten dat bepaalde gebieden simpelweg niet zonder menselijke controle mogen opereren. Ik heb de lijst bekeken en dit zijn gebieden waar fouten catastrofaal kunnen zijn:

- Kernenergieveiligheid.

- Productie van drinkwater.

- Gezondheidszorg en kritieke transportnetwerken.

- Financiële beslissingen, zoals kredietbeoordelingen of leningaanvragen.

Dit betekent dat als een AI op de een of andere manier een fout maakt in jouw medisch dossier of je hypotheekaanvraag afkeurt, er altijd een mens achteraf moet kunnen ingrijpen en de beslissing moet verantwoorden. Een geruststellende gedachte, maar het vertraagt wel de snelheid waarmee AI opereert.

De plicht tot labeling: geen verwarring meer

Een andere cruciale regel waar je op moet letten, is de verplichting tot labeling. Bedrijven moeten je duidelijk maken wanneer je interacteert met een hoog-impact of generatieve AI (denk aan ChatGPT of generatieve afbeeldingstools).

Hier komt de pijn voor K-startups: als ze het naambordje van hun AI vergeten, hangt er een fikse straf boven hun hoofd. Een boete van 30 miljoen won (ongeveer €20.000) voor het niet labelen van generatieve AI is mild vergeleken met de sancties voor ernstige overtredingen.

Bij zwaardere overtredingen kunnen de boetes oplopen tot 1% van de wereldwijde omzet, en bij misbruik van hoog-risico AI zelfs tot 7% van die omzet. Dat is het soort druk dat innovatieve bedrijven soms doet kiezen voor de veilige, saaie route.

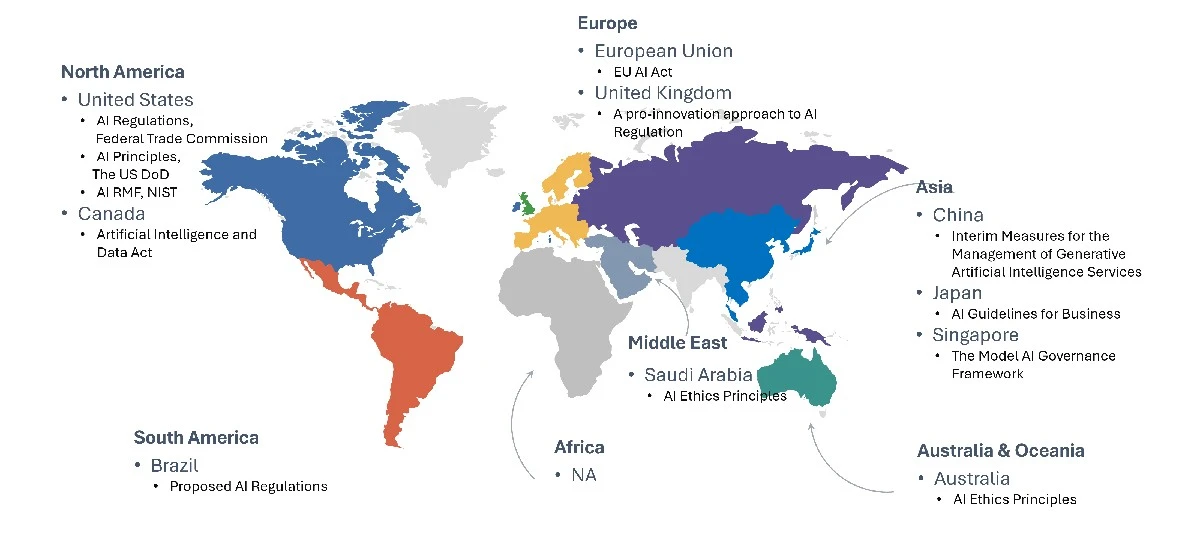

De Aziatische trend: Strengheid als standaard

Zuid-Korea is niet de eerste die deze kant op kijkt. Ze volgen een trend die al ingezet is door hun buren:

- China: Richt zich sterk op de emotionele connectie. Hun regels eisen dat AI-providers waarschuwen bij overmatig langdurig gebruik en zelfs moeten kunnen ingrijpen als een gebruiker tekenen van verslaving vertoont. De nadruk ligt hier bijna op de 'persoonlijkheid' van de AI.

- Indonesië: De Indonesiërs zijn bezig met een nationale AI Ethics Roadmap. Zij maken een 'paraplu-wet' waarbinnen sectoren zelf hun specifieke regels mogen opstellen. Dit geeft hen flexibiliteit, maar kan leiden tot gaten in de dekking.

Wat ik hierin zie, is dat veel landen, waaronder ook de Europese Unie met hun AI Act, de focus leggen op risicobeheer. Ze willen niet dat de technologie de samenleving onder druk zet voordat de ethische kaders er zijn.

Het nadeel: de innovatiekater

Hoewel de intentie nobel is, is er binnen de Koreaanse startup-scene veel frustratie. De taal van de nieuwe wetgeving is vaak vaag. Oprichters zijn bang dat ze, om boetes te vermijden, de meest innovatieve (en dus risicovolle) AI-toepassingen schuwen.

Als je in Nederland een startup probeert op te zetten, kun je dit scenario voor je zien: je hebt een briljant idee, maar de onduidelijke regels zorgen ervoor dat je liever een veilige, minder winstgevende kloon van een bestaande dienst bouwt. Dit is de paradox van snelle regulering.

Wat is jouw volgende stap?

Het is duidelijk dat AI-regulering de norm wordt, niet de uitzondering. Voor ons als consument betekent dit meer transparantie, maar ook dat de nieuwste, meest spannende AI-tools mogelijk vertraagd worden geïntroduceerd.

Wat vind jij van deze strenge aanpak? Zou een verplichte menselijke controle bij jouw hypotheekaanvraag je meer geruststellen, of zie je het vooral als een rem op vooruitgang?