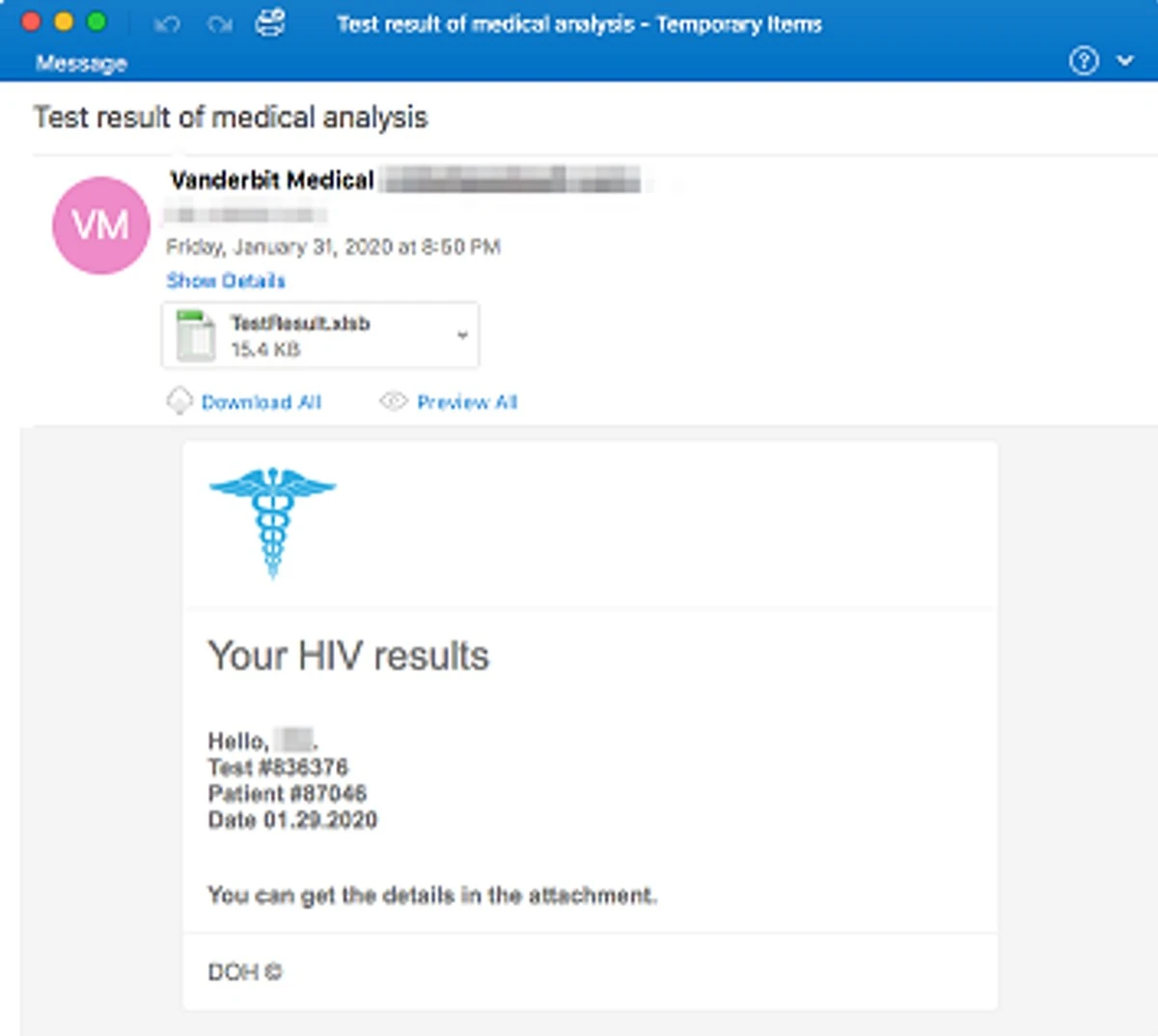

Stel je voor: je typt een medische vraag in ChatGPT en krijgt direct een helder, gedetailleerd antwoord. Klinkt bevrijdend, toch? Nieuw onderzoek toont echter aan dat we massaal vertrouwen op deze digitale doktoren, zelfs nu we weten dat één op de vier diagnoses regelrecht verzonnen is. Dit is een patroon dat we als Nederlanders vaak zien bij nieuwe technologieën: we omarmen het gemak, maar vergeten de risico’s.

Het is verleidelijk om de snelheid te verkiezen boven de zekerheid van een menselijke specialist. Maar in mijn ervaring met deze nieuwe tech-trends moet ik je waarschuwen: deze snelheid heeft een verborgen prijs, vooral als het om je gezondheid gaat. Je zou zomaar advies kunnen volgen dat letterlijk uit de lucht komt vallen.

Het MIT-onderzoek: de menselijke voorkeur voor algoritmes

Onderzoekers van het MIT hebben recentelijk iets opvallends ontdekt dat de artsen in de wachtkamer laat schrikken. Ze lieten proefpersonen medische scenario’s beoordelen door drie bronnen: een echte medisch specialist, een betrouwbaar digitaal platform, en een generatief AI-model.

De uitkomst was haast ongelooflijk. Veel deelnemers gaven de voorkeur aan het AI-antwoord. Waarom? De presentatie was overtuigender en leek completer. Het voelde alsof je een dik naslagwerk opensloeg in plaats van een kort doktersadvies.

De illusie van autoriteit

We hebben de neiging om goed geformuleerde taal, hoe onjuist ook, als autoritair te interpreteren. Dit zie je ook bij de marketingteksten die je tegenkomt op je favoriete Nederlandse nieuwsapps: ze klinken deskundig, maar ontbreken aan substantiële basis.

- De AI gebruikt jargon alsof het een professor is.

- De antwoorden zijn vlot en zonder de aarzeling die echte experts soms tonen.

- Mensen scoren de output van AI hoger op 'volledigheid' dan die van een mens.

Het gevaar zit hem in het feit dat we de output van de machine niet kunnen uitzonderen op fouten. Als je je realiseert dat je na het volgende advies naar de drogist rent voor dat ene 'geheime middel' dat de AI je aanraadde, is de kans groot dat het middel niet bestaat.

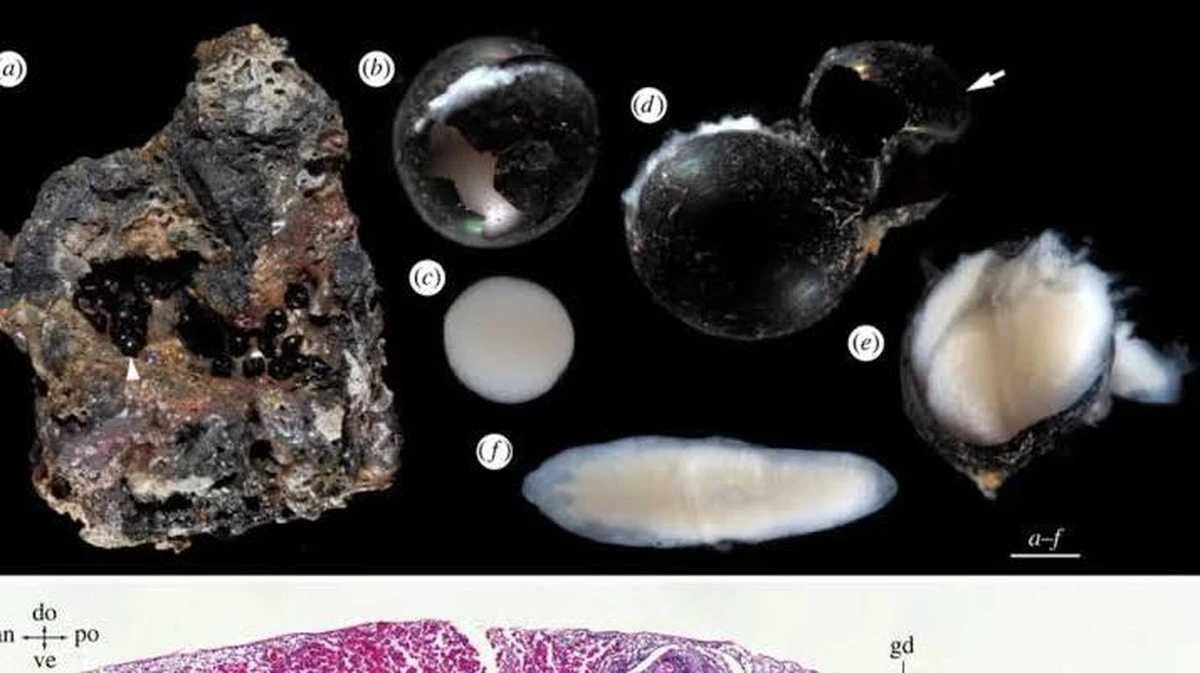

Waarom de 'onzin-diagnose' zo moeilijk te herkennen is

Het is geen kwestie van slechte software; het zijn de *hallucinaties* van de modellen die hier parten spelen. De AI probeert de gaten in haar kennis op een logisch klinkende manier in te vullen.

Dit leidt tot een cruciaal probleem dat veel verder gaat dan een verkeerd advies over je niesbui. De experts waarschuwen: de AI mist het klinische inzicht. Ze kan geen context inschatten zoals een huisarts dat doet na jarenlang patiënten voor zich te zien in de spreekkamer.

Een specialist in de studie vatte het treffend samen: "De AI oefent geneeskunde uit zonder de juiste opleiding daarvoor te hebben gehad."

Het academische kabaal: Meer publiceren, minder kwaliteit

Dit wantrouwen in medische AI is verweven met een breder probleem in de wetenschap. Uit Cornell-onderzoek blijkt dat onderzoekers die AI inzetten tot wel 50% meer artikelen publiceren dan hun collega's.

Maar hier komt de koude douche: deze artikelen worden **minder vaak geaccepteerd** door gerenommeerde tijdschriften. Het lijkt erop dat de kwantiteit de kwaliteit opvreett, of op zijn minst de wetenschappelijke meerwaarde vermindert. Dit fenomeen zie je nu ook in bijvoorbeeld het schrijven van kortere artikelen over het weer in de provincie Utrecht; het volume neemt toe, maar de diepgang verdwijnt.

Wat jij nu direct moet doen

Ik begrijp de drang naar snelle antwoorden, zeker met de drukte van het dagelijks leven. Maar bij gezondheid moet je altijd de 'klik' maken naar een mens.

Hier is de hack die je vandaag nog moet toepassen als je toch AI gebruikt voor medische vragen:

- Valideer de bron: Vraag de AI expliciet onder welke bron of studie het advies is gebaseerd. Als het antwoord is "Als een groot taalmodel...", dan weet je genoeg.

- Vermijd 'zelfdiagnose': Gebruik AI alleen voor uitleg van bestaande (door je arts gegeven) diagnoses, niet voor het stellen ervan.

- Maak de menselijke check: Als het advies een specifieke actie vereist (zoals het stoppen met een medicijn of het kopen van een specifiek supplement), bel dan altijd je eigen apotheker of huisarts. Vertrouw niet op iets wat eruitziet alsof het bij de Kruidvat in de schappen ligt, maar is verzonnen door een server.

De AI is een handige assistent, maar geen vervanging van de arts in zijn spreekkamer. Laten we de techniek gebruiken om beter geïnformeerd te zijn, niet om betere gokkers te worden over onze eigen gezondheid.

Ben jij wel eens betrapt op het volgen van een onjuist medisch advies dat je online vond? Deel je ervaring hieronder; het helpt anderen om kritischer te blijven.