Je denkt dat jij de baas bent over je Netflix-keuzes of je route naar werk, maar de waarheid is soms een stuk minder geruststellend. Kunstmatige intelligentie wordt niet alleen door ons gevormd; wij passen ons in een verbazingwekkend tempo aan de logica van de machine aan.

In mijn praktijk als AI-volger zie ik dagelijks hoe subtiel dit proces verloopt. We schrijven kortere zinnen voor chatbots, accepteren aanbevelingen blindelings, en veranderen ongemerkt ons koopgedrag. Dit is geen sciencefiction meer; het is de nieuwste gewoonte van de Nederlander.

Waarom je al anders denkt dan een jaar geleden

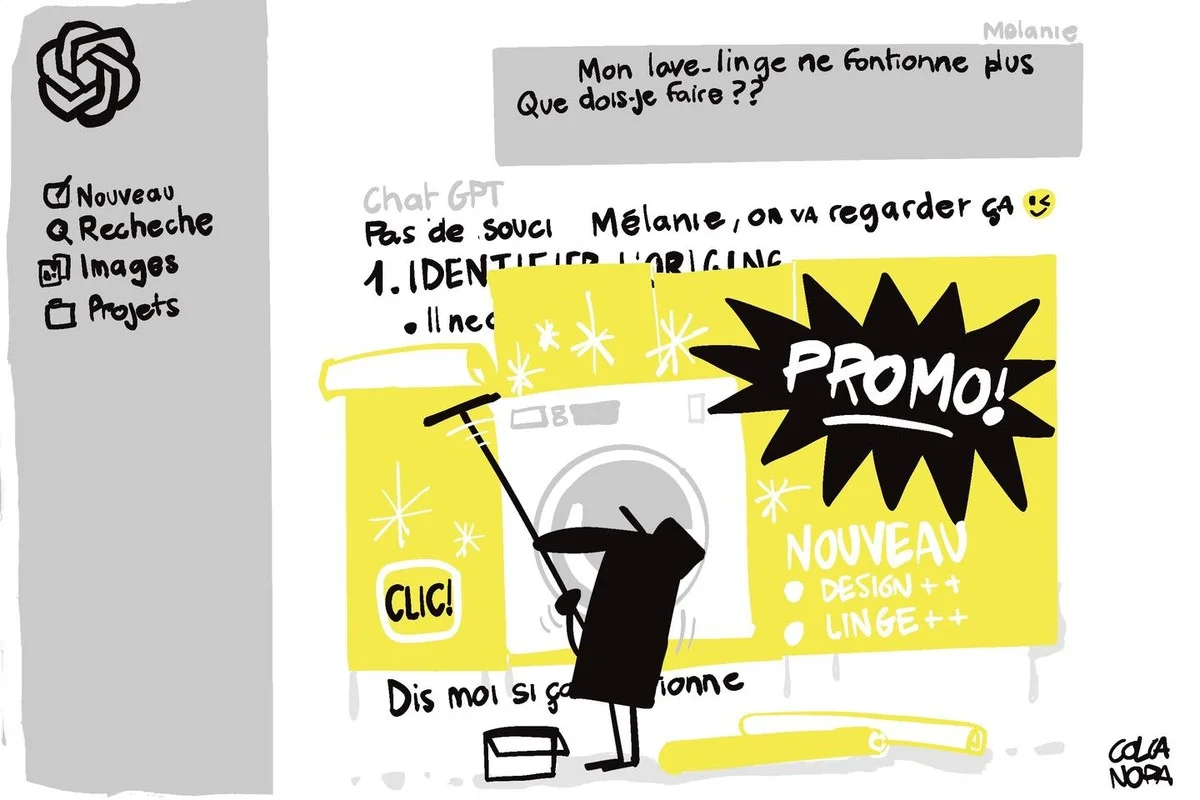

We zien AI als een 'tool', een ding dat wij bedienen. Maar de wisselwerking is tweerichtingsverkeer. Denk aan de manier waarop je boodschappen doet. Vroeger bladerde je door de folders van Albert Heijn en Jumbo; nu dicteert de app wat je voornamelijk ziet.

Dit 'ontwerp dat duwt' is de kern. Neem bijvoorbeeld muziekvoorkeuren. Als Spotify je drie keer achter elkaar een genre aansmeert dat nét niet past, pas je je playlist-gedrag aan, zodat de volgende keer de kans op een goede match groter is. Je optimaliseert je input voor de machine.

Het brein en de algoritmes: Verrassend gespiegeld

Het meest fascinerende is hoe de werking van complexe AI-systemen lijken op ons eigen brein. Professor Karl Friston stelde al dat ons brein constant gissingen doet om verrassingen te minimaliseren. AI doet exact hetzelfde, maar dan met data.

Wanneer ChatGPT een tekst genereert, berekent het de meest waarschijnlijke woordvolgorde, gebaseerd op miljarden patronen. Dit is de reden waarom AI soms zo overtuigend klinkt, maar ook waarom het zo makkelijk fouten maakt.

- Het Gevaar van de Gissing: Net als wij in het donker een jas voor een persoon aanzien, 'gokt' AI ook. Als de data schaars of dubbelzinnig is, kiest de AI voor de meest voorkomende (maar niet noodzakelijk juiste) optie.

- Leesbaarheid boven Waarheid: AI kiest taal die klinkt alsof het klopt, niet taal waarvan het weet dat het klopt. Dit is de valkuil van de 'mooie praatjesmaker'.

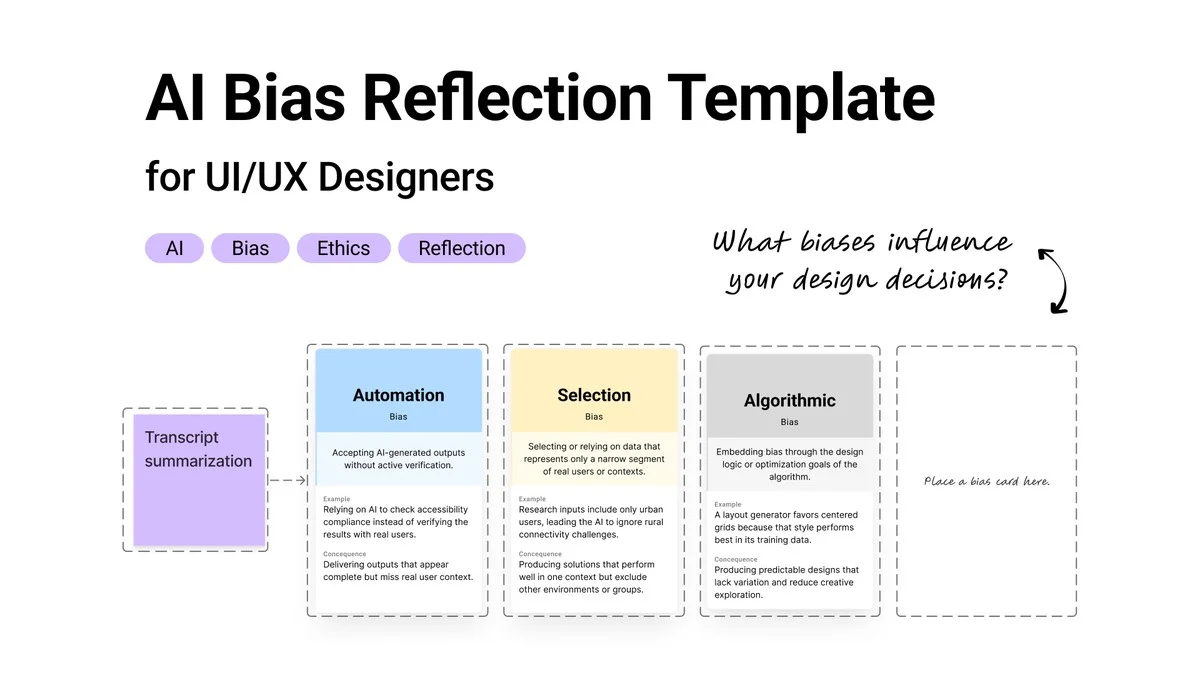

De schaduwkant: AI onthult onze vooroordelen

Veel mensen denken dat AI neutraal is, een objectieve scheidsrechter. Dat is een luxe gedachte die we ons niet kunnen permitteren. AI is een spiegel van de data waarmee het gevoed wordt – en onze data zit vol menselijke vooroordelen.

Als een IT-bedrijf in Amsterdam historische sollicitatiegegevens gebruikt om een AI te trainen voor de volgende wervingsronde, en die data laat zien dat mannen vaker werden aangenomen voor technische functies, dan zal de AI dit nu versterken. De machine selecteert onbewust op basis van het verleden.

Dit zie je niet alleen bij sollicitaties, maar ook in hoe beelden gegenereerd worden. Is de 'CEO' altijd een man van pakweg 45? Dan zal de AI dat patroon meesterlijk reproduceren, totdat wij bewust ingrijpen.

Wanneer 'gezond verstand' ontbreekt

Een zelfrijdende auto of een gezichtsherkenningssysteem in Schiphol mist de context die jij wel hebt. Een mens ziet een sticker op een verkeersbord en begrijpt dat het nog steeds een stopteken is. Een AI ziet slechts afwijkende pixels.

Deze systemen missen de betekenis achter patronen. Ze zien de vorm, niet het doel. En dat gebrek aan basaal inzicht kan, zoals Sune Lehmann terecht opmerkt, leiden tot voorspelbaarheid die oncomfortabel is. De algoritmes kennen je gewoontes beter dan jijzelf.

Hoe we de spiegel kunnen gebruiken

Het goede nieuws is dat deze reflectie ook een krachtig hulpmiddel is. Als AI ons laat zien dat we binnen de psychologie te veel op witte mannen hebben gefocust, of dat onze algoritmes in de financiële sector bepaalde wijken uitsluiten, dan hebben we een kans.

We moeten AI niet zien als een onfeilbare orakel, maar als een kritische, onhandige assistent die ons onze eigen blinde vlekken toont. Door te begrijpen hoe het systeem fouten maakt, kunnen we betere, eerlijkere systemen bouwen.

Wat is de meest verrassende aanpassing die jij hebt gemerkt in je eigen gedrag sinds de opkomst van slimme algoritmen? Deel je ervaring hieronder!